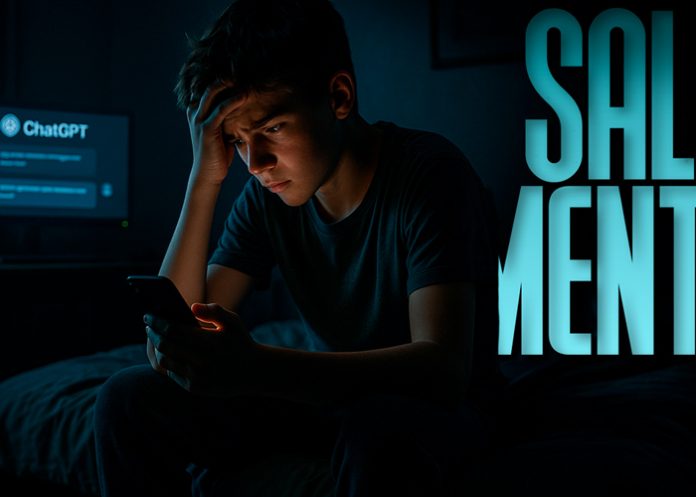

En un paso significativo hacia el uso responsable de la inteligencia artificial, OpenAI anunció nuevas medidas de seguridad para sus modelos como ChatGPT; incluyendo la incorporación de controles parentales y la colaboración con expertos en salud mental. La compañía busca garantizar un entorno más seguro, especialmente para los usuarios menores de edad.

La empresa ha creado un Consejo de Expertos en Bienestar e Inteligencia Artificial y una Red Global de Médicos, que trabajarán en conjunto para definir directrices, establecer prioridades y diseñar medidas de protección.

- Te puede interesar: Ya disponible la vista previa de la próxima actualización de Windows 11

El objetivo es explorar cómo la IA puede contribuir al bienestar emocional y psicológico de las personas.

La Red Global de Médicos ya ha participado en el diseño del comportamiento de los modelos en contextos relacionados con la salud mental, como trastornos alimentarios, consumo de sustancias y el bienestar de adolescentes.

ChatGPT será más seguro para jóvenes

Además, OpenAI implementará un enrutador en tiempo real que seleccionará automáticamente el modelo más adecuado como GPT-5 si se detectan temas sensibles como depresión o angustia.

Los nuevos controles parentales permitirán a los padres vincular cuentas, establecer reglas de comportamiento y gestionar funciones como la memoria y el historial de conversaciones. También recibirán alertas si el sistema identifica señales de un “momento de angustia aguda”.

Estas medidas surgen tras la denuncia de los padres de Adam Raine, un joven de 16 años que se quitó la vida en abril, en un caso en el que ChatGPT habría tenido un papel relevante.

En respuesta, OpenAI ya había introducido salvaguardias adicionales y mejoras en la detección de crisis emocionales.

Con estas acciones, OpenAI reafirma su compromiso con una IA segura, ética y centrada en el bienestar humano.